Wenn ein Mensch halluziniert, gibt dies Anlass zur Sorge, da das Gehirn nicht richtig funktioniert. Plappert eine Künstliche Intelligenz Irrsinn, führt dies meistens nur zu Irritationen. Dabei können Fehler verheerend sein, etwa wenn ein Large Language Model (LLM) Gesetze ignoriert, desaströse Finanzentscheidungen für ein Unternehmen trifft oder einem Krebspatienten beste Gesundheit attestiert.

„Es besteht die Gefahr, dass die Modelle so undurchsichtig werden, dass Menschen die Ergebnisse nicht mehr prüfen, verstehen oder anpassen können“, sagt Teodor Chiaburu. Der Doktorand forscht im Forschungsverbund Data Science +X der Berliner Hochschule für Technik (BHT) an der Zuverlässigkeit von Künstlicher Intelligenz.

Bekannte Modelle wie ChatGPT oder der Bildgenerator Stable Diffusion sind inzwischen äußerst komplex. Für ihre Berechnungen berücksichtigen sie eine Milliardenzahl an Parametern. Selbst für Expert*innen ist die KI mittlerweile oft eine „Black Box“. „Es wird immer schwieriger zu verstehen, wie die Modelle im Detail funktionieren“, sagt Chiaburu, der sich mit Erklärbarer Künstlicher Intelligenz (eXplainable Artificial Intelligence, XAI) beschäftigt. Der Forschungszweig versucht zu klären, warum ein KI-Modell zu einer bestimmten Entscheidung kommt und auf welchen Faktoren sie beruht – ähnlich wie ein Arzt seine Diagnose erklärt.

Gründe für „Unsicherheit“

In der XAI spielt der Begriff der „Unsicherheit“ eine wichtige Rolle. Sie beschreibt, wie verlässlich eine konkrete Erklärung und eine konkrete Begründung für einen Modell-Output ist. Unzuverlässigkeit kann verschiedene Ursachen haben:

- Die Trainingsdaten sind verzerrt oder fehlerhaft, zum Beispiel wegen einer unpräzisen oder fehlerhaften Datensammlung.

- Das KI-Vorhersagemodell stößt an seine Grenzen, etwa bei besonders komplexen Aufgaben oder seltenen Fällen, für die es nur wenige Beispiele gelernt hat.

- Die Methode, mit der das Ergebnis erklärt wird, ist unzuverlässig. So können Erklärungen überzeugend sein, obwohl sie in die Irre führen. Dies gilt genauso umgekehrt.

In der XAI-Forschung sind zahlreiche Methoden entstanden, um die Unsicherheit von KI-Antworten darzustellen. Dafür versuchen sie, Zusammenhänge zwischen Trainingsdaten, Modell, Erklärungsmethode und Output herzustellen. Gleichzeitig zeigen Studien, dass viele Erklärungen, die keine Unsicherheit messen oder kommunizieren, fragwürdige Ergebnisse liefern können:

- Sie sind von irrelevanten Merkmalen in den Daten geprägt und daher schwer interpretierbar.

- Sie verändern sich selbst bei sehr ähnlichen Fällen ständig.

- Vergleichbare Entscheidungen werden mit Begründungen erklärt, die sich widersprechen.

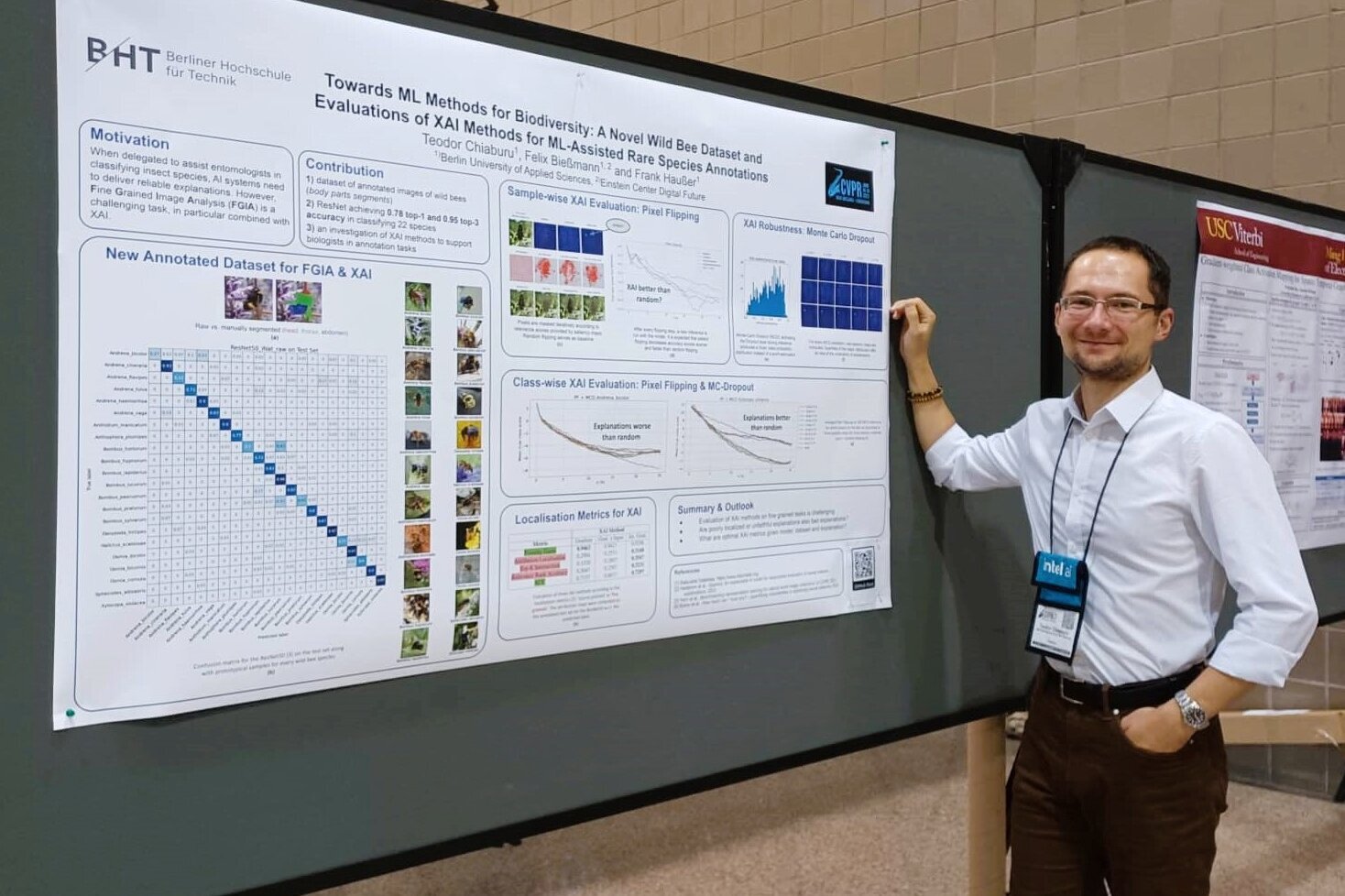

In seiner Doktorarbeit, betreut von Prof. Dr. Felix Bießmann und Prof. Dr. Frank Haußer, untersucht der KI-Forscher, welche XAI-Methoden besonders robust oder empfindlich sind. Ziel ist es, herauszufinden, wie sich Unsicherheit in XAI messen lässt, wo sie herkommt und wie man sie effizient kommuniziert. Dafür hat Chiaburu einen Modellierungsansatz entwickelt, mit dem sich Erklärungsmethoden um Unsicherheitsschätzungen ergänzen lassen, und Kriterien, mit denen ihre Robustheit überprüft werden kann. Mit seiner Forschung trägt er dazu bei, XAI-Methoden stabil und verlässlich zu machen.

EU setzt Standards

Um XAI-Verfahren effizient anwenden zu können, ist ein tieferer Einblick in die Architektur der großen KI-Modelle notwendig, genauso wie ein Verständnis, welche Trainingsdaten verwendet wurden und wie sie verarbeitet wurden. Im Gegensatz zu Open-Source-Modellen halten die meisten großen US-Tech-Konzerne ihre bekannten Systeme hingegen geschlossen. Dies habe Folgen für die Forschung.

„Es ist schwierig, einheitliche XAI-Standards weltweit zu verankern. In dieser Hinsicht ist die EU mit dem 2024 in Kraft getretenen EU-AI-Act Vorreiter, allerdings bisher alleinstehend“, sagt Teodor Chiaburu. Solche Standards seien notwendig und wichtig:

„Die Modelle kommen zunehmend in kritischen Bereichen wie der Medizin zum Einsatz. Es wäre schade, wenn die enormen Vorteile der KI wegen Misstrauen oder Intransparenz nicht genutzt werden könnten.“

Zur Person: Teodor Chiaburu

In seiner Forschung beschäftigt sich Teodor Chiaburu mit Künstlicher Intelligenz. Die akademische Laufbahn begann er mit einem Bachelorstudium in Linguistik an der Humboldt-Universität zu Berlin. An der BHT absolvierte er einen Bachelor in Angewandter Mathematik und einen Master in Data Science. Während seines Studiums engagierte er sich im KI-Projekt KInsecta, für das er maschinelle Lernmodelle entwickelte, mit denen sich Insekten anhand ihres Flügelschlags bestimmen lassen.

In seiner Promotion, betreut von Prof. Dr. Felix Bießmann und Prof. Dr. Frank Haußer, untersucht Teodor Chiaburu Methoden der Erklärbaren Künstlichen Intelligenz (XAI). Dabei analysiert er, was eine gute Erklärung ausmacht und wie man ihre Unsicherheit am besten misst. Im Rahmen seiner Promotion war er in mehreren Forschungsprojekten an der BHT tätig, die KI-Lösungen für Umweltprobleme entwickelten, etwa für Abwasser-Management und automatische Bodenprofilbeschreibungen.